Hand aufs Herz: Wenn Sie an Microsoft denken, sehen Sie wahrscheinlich Excel-Tabellen oder die vertrauten Fenster Ihres Desktop-Betriebssystems vor sich – aber sicher keine Roboter, die eines Tages unsere Häuser bauen. Microsofts Flirt mit der Robotik war bisher eher eine On-Off-Beziehung. Viele von uns haben noch eine staubige Ecke im Gedächtnis für das Microsoft Robotics Developer Studio reserviert, diesen ambitionierten Versuch von 2006, ein „Windows für Roboter“ zu etablieren, der schließlich sang- und klanglos im digitalen Giftschrank verschwand. Es war ein edles Unterfangen, aber letztlich eine Plattform auf der Suche nach einem Problem, für das der Markt schlicht noch nicht bereit war.

Doch wir schreiben das Jahr 2026. Die Karten wurden neu gemischt. Microsoft, durch die tiefe Allianz mit OpenAI massiv unter Strom gesetzt, ist längst kein reiner Software-Riese mehr; das Unternehmen ist ein KI-Behemoth. Und jetzt holt Redmond zum nächsten, weitaus gewaltigeren Schlag in der Robotik aus. Diesmal geht es nicht nur um ein Entwickler-Kit. Es geht um das eine, universelle Gehirn – ein Basismodell für die physische Welt, das alles steuern könnte, vom hochpräzisen Fabrikarm bis zum humanoiden Assistenten. Das Ziel ist es, endlich die Kluft zwischen digitaler Intelligenz und physischem Handeln zu überbrücken – eine Herausforderung, die Experten als „Embodied AI“ bezeichnen.

Von Sprachmodellen zur „Physical AI“

Jahrelang waren Roboter in strukturierten Umgebungen unschlagbar. Eine Montagehalle in der Automobilindustrie ist das Paradies für eine Maschine: Jedes Teil liegt an einem vorhersehbaren Ort, jede Aufgabe ist repetitiv, und die Fehlertoleranz liegt bei null. Doch in dem Moment, in dem man diesen Roboter aus seinem Käfig holt und ihn in die chaotische, unberechenbare Welt der Menschen entlässt, verwandelt er sich in einen sündhaft teuren Briefbeschwerer. Genau dieses Problem greift Microsoft jetzt an.

Die große Vision des Unternehmens ist die Erschaffung einer sogenannten „Physical AI“. Dabei werden dieselben Prinzipien genutzt, die Modelle wie GPT-4 so leistungsfähig gemacht haben. Der neue Star dieser Initiative ist Rho-alpha, Microsofts erstes Robotik-Modell, das auf der Phi-Serie von Vision-Language-Modellen basiert. Wie Ashley Llorens, VP bei Microsoft Research, erklärt, geht es darum, Systemen zu ermöglichen, „in Umgebungen, die weitaus weniger strukturiert sind, mit zunehmender Autonomie an der Seite von Menschen wahrzunehmen, zu schlussfolgern und zu handeln.“

Im Grunde wollen sie ein Modell bauen, das nicht nur den Befehl „Hebe die blaue Kiste auf“ versteht, sondern auch die Physik des Hebens begreift, das intuitive Wissen besitzt, dass man die Kiste nicht zerquetschen darf, und die Fähigkeit besitzt, sich anzupassen, wenn die Kiste ein paar Zentimeter daneben steht. Es ist der Schritt weg von starren, vorprogrammierten Befehlen hin zu einer flüssigen, anpassungsfähigen Intelligenz.

Der VLA+-Vorteil: Fingerspitzengefühl ist alles

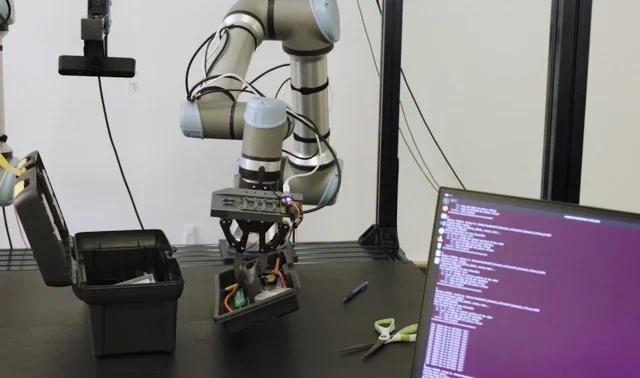

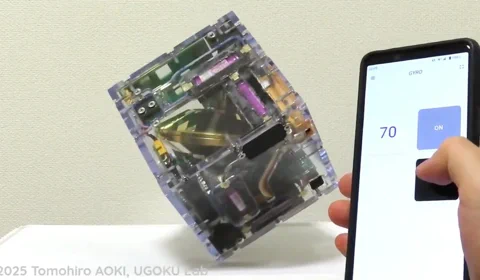

Das Geheimrezept von Rho-alpha liegt in seiner Architektur, die Microsoft als „Vision-Language-Action Plus“ (VLA+) bezeichnet. Im Gegensatz zu früheren Modellen von Konkurrenten wie Google DeepMind, die sich primär auf Bilderkennung und Sprache (VLA) verlassen, fügt Rho-alpha eine entscheidende Komponente hinzu: den Tastsinn. Durch die Integration taktiler Sensorik kann das Modell Kontaktzustände mit Objekten verstehen und filigrane Aufgaben bewältigen – wie das Einstecken eines Kabels oder das Drehen eines feinen Reglers –, die allein mit Kamerasicht kaum machbar wären.

Natürlich stößt der Bau eines solchen Modells auf das größte Nadelöhr der Robotik: den massiven Mangel an hochwertigen Daten. Man kann das Internet nicht einfach nach Billionen Beispielen durchforsten, wie ein Roboter einen Schraubenzieher hält. Um dieses Problem zu lösen, setzt Microsoft massiv auf Simulationen.

„Das Training von Basismodellen, die logisch denken und handeln können, erfordert die Überwindung des Mangels an vielfältigen Realdaten“, sagt Deepu Talla, Vice President of Robotics and Edge AI bei NVIDIA. „Durch die Nutzung von NVIDIA Isaac Sim auf Azure zur Generierung physikalisch korrekter synthetischer Datensätze beschleunigt Microsoft Research die Entwicklung vielseitiger Modelle wie Rho-alpha.“

Diese Kombination aus synthetischen Daten, die in Simulationen generiert werden, und physischen Demonstrationen aus der echten Welt ist der Schlüssel, um diese Modelle im großen Stil zu trainieren. Wenn der Roboter unweigerlich einen Fehler macht, kann ein menschlicher Operator ihn mit einer 3D-Maus korrigieren, und das System lernt in Echtzeit aus diesem Feedback.

Ein Betriebssystem für verkörperte Intelligenz

Sollte Microsoft der Durchbruch gelingen, wären die Auswirkungen gigantisch. Ein Allzweck-Robotikmodell könnte wie ein cloudbasiertes Betriebssystem für Hardware fungieren. Anstatt dass jedes Robotik-Startup seinen eigenen komplexen KI-Stack von Grund auf neu entwickelt, könnten sie ein hochgradig fähiges Basismodell von Microsoft lizenzieren und sich auf das Design besserer Hardware konzentrieren. Das würde die Eintrittsbarrieren dramatisch senken und könnte eine Art „kambrische Explosion“ neuer Roboterformen und Anwendungen auslösen.

Damit begibt sich Microsoft in den direkten Zweikampf mit anderen Tech-Giganten, die dieselbe Vision verfolgen. NVIDIA baut mit seinem Projekt GR00T ein ähnliches Basismodell und nutzt dabei seine Dominanz bei KI-Hardware und die Omniverse-Simulationsplattform für ein mächtiges Ökosystem-Spiel. Tesla verfolgt mit Optimus einen vertikal integrierten Ansatz und wettet darauf, dass sein riesiger Fundus an realen Fahrdaten den entscheidenden Vorteil beim Verständnis der physischen Welt liefert. Und Google ist in diesem Bereich ohnehin seit Jahren ein Forschungs-Schwergewicht.

Microsofts Strategie scheint ein reiner Plattform-Ansatz zu sein. Indem das Unternehmen Rho-alpha über ein Early-Access-Programm und später über Microsoft Foundry zugänglich macht, lädt es Partner ein, auf seinem Fundament aufzubauen. Dieser kollaborative Ansatz, gestützt durch die immense Skalierbarkeit der Azure-Cloud-Infrastruktur, ist Microsofts zentraler Trumpf.

Der Traum vom Allround-Roboter ist zwar noch ein gutes Stück von der Realität entfernt. Die Herausforderungen der realen Physik, der Sicherheit und der Kosten sind monumental. Aber zum ersten Mal fühlt sich die Software-Seite plausibel an. Microsofts ambitionierter Vorstoß in die „Physical AI“ ist nicht nur ein weiteres Forschungsprojekt; es ist das klare Signal, dass das Rennen um das Gehirn, das die nächste Generation von Maschinen steuern wird, endgültig eröffnet ist. Und dieses Mal ist Microsoft ein verdammt ernstzunehmender Kandidat.