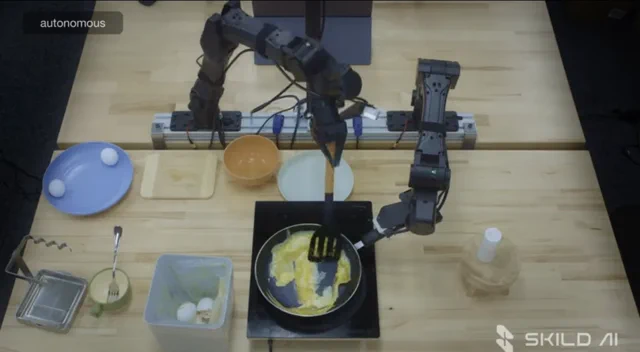

Im großen, oft etwas unbeholfenen Marathon hin zu vielseitig einsetzbaren Robotern ist die Industrie immer wieder über dasselbe lästige Hindernis gestolpert: Daten. Während sich Sprachmodelle am gesamten Internet – einem wahren Schlaraffenland an Texten – sattfressen konnten, war die Robotik dazu verdammt, ihre Kreationen mit der langsamen, teuren und schmerzlich begrenzten Diät der Teleoperation von Hand zu füttern. Doch jetzt hat ein Startup namens Skild AI beschlossen, mit dem Löffel füttern aufzuhören und ihren Robotern einfach die Speisekarte zu zeigen. Ihr jüngster Beweis? Ein Roboterarm, der einen Teller Rührei zaubern kann, nachdem er die Fähigkeit durch das Ansehen eines menschlichen Videos gelernt hat.

Das ist nicht nur ein netter Partygag. Es ist ein direkter Angriff auf das, was zum zentralen Problem der physischen KI geworden ist: den Daten-Engpass. Die gängige Methode, Roboter zu trainieren, beinhaltet, dass menschliche Bediener eine Maschine fernsteuern oder „puppenspielerisch“ führen, um die präzisen Motorsteuerungsdaten für eine Aufgabe zu sammeln. Wie Skild AI betont, ist diese Strategie mit zwei fatalen Mängeln behaftet: Sie ist nicht vielfältig genug, da die meisten Daten in sterilen Laborumgebungen gesammelt werden, und es ist mathematisch unmöglich, sie auf das Niveau zu skalieren, das für ein echtes Foundation Model erforderlich wäre. Man kann schlichtweg nicht genug Menschen einstellen, um Roboter rund um die Uhr zu steuern und die erforderlichen Billionen von Datenpunkten zu generieren.

Die YouTube-zu-Roboter-Pipeline

Anstatt zu versuchen, eine größere Datenfarm aufzubauen, bedient sich Skild AI einer bereits existierenden: dem Internet. Die zentrale Erkenntnis des Unternehmens ist, dass Menschen bereits einen „Internet-Skala“-Datensatz für die Robotik geschaffen haben, und zwar in Form von YouTube-Tutorials, TikTok-Hacks und unzähligen anderen Lehrvideos. Die Lösung, die die ganze Zeit vor aller Augen lag, ist das Beobachtungslernen – genau die Art und Weise, wie Menschen lernen. Wir lernen nicht, ein Getränk einzuschenken, indem wir Flüssigkeitsdynamik berechnen; wir schauen jemandem zu, wie er es tut, und unser Gehirn erledigt den Rest.

Skild AI bringt seinen Modellen bei, dasselbe zu tun. Indem die KI Videos von Menschen bei der Ausführung von Aufgaben beobachtet, lernt sie die Absicht und die Abfolge der Aktionen und übersetzt effektiv eine visuelle Demonstration in Roboterbefehle.

Natürlich ist es nicht so einfach. Einem Roboter ein Video von Gordon Ramsay zu zeigen, wie er Beef Wellington zubereitet, und dann ein Michelin-Sterne-Menü zu erwarten, ist reine Fantasie. Die primäre technische Herausforderung ist das, was die Branche als „Embodiment Gap“ bezeichnet. Eine menschliche Hand hat 27 Freiheitsgrade; ein zweifingriger Greifer nicht. Die fließenden Bewegungen eines menschlichen Kochs auf die starren Gelenke eines mehrachsigen Roboterarms abzubilden, ist ein gigantisches Übersetzungsproblem.

Omni-bodied Learning und das Skild Brain

Hier, so behauptet Skild AI, liegt ihre Geheimzutat. Das Unternehmen hat ein sogenanntes „omni-bodied“ Foundation Model entwickelt, das auf den Namen Skild Brain hört. Diese KI ist darauf ausgelegt, hardwareagnostisch zu sein, fähig, verschiedene Roboterformen – von rollenden Humanoiden bis hin zu stationären Armen – zu steuern, ohne für eine einzige davon überspezialisiert zu sein. Das Modell wird mit einer riesigen Menge menschlicher Videos und physikbasierter Simulationen vortrainiert, wodurch es ein generalisiertes Verständnis dafür entwickeln kann, wie Objekte manipuliert werden sollten.

„Lernen durch Erfahrung und nicht durch Vorprogrammierung ist der grundlegende Wandel, der in der Robotik stattgefunden hat“, erklärte das Unternehmen und hob hervor, wie es die Simulations- und KI-Infrastruktur von NVIDIA nutzte, um „ein Jahrtausend an Erfahrung innerhalb von Tagen“ zu erwerben.

Dieser Ansatz ermöglicht es dem Roboter, eine neue Fähigkeit aus einem Video mit weniger als einer Stunde roboterspezifischer Daten zum Fine-Tuning zu erlernen. Das Ergebnis ist ein System, das über verschiedene Aufgaben und Umgebungen hinweg generalisieren kann, wie in ihren Demos von Robotern zu sehen ist, die Geschirrspüler beladen, Pflanzen gießen und Vorhänge zuziehen.

Auswirkungen auf die Roboterrevolution

Wenn sich der Ansatz von Skild AI als so skalierbar und effektiv erweist, wie das Unternehmen behauptet, sind die Auswirkungen enorm. Er verändert die Wirtschaftlichkeit des Robotertrainings grundlegend. Der Bedarf an riesigen, teuren Teleoperationsfarmen könnte durch leistungsstarke Modelle ersetzt werden, die aus einer ständig wachsenden, öffentlich zugänglichen Bibliothek menschlicher Aktivitäten lernen. Dies könnte den Einsatz von Robotern in unstrukturierten Umgebungen wie Haushalten, Restaurants und auf Baustellen – Orten, an denen die Automatisierung traditionell zu kämpfen hatte – dramatisch beschleunigen.

Die Branche nimmt Notiz. Konkurrenten im Bereich humanoider und allgemeiner Roboter setzen alle ihre eigenen hohen Wetten auf die Lösung des Datenproblems, sei es durch Teleoperation, Simulation oder menschliche Videos.

Vorerst hat Skild AI eine überzeugende und, offen gesagt, köstlich aussehende Demonstration geliefert. Während der Rest der Welt damit beschäftigt ist, Inhalte für Menschen zum Anschauen zu erstellen, verwandelt Skild diese Inhalte still und heimlich in einen Lehrplan für unsere zukünftigen Roboterassistenten. Das Zeitalter des selbstlernenden Roboterkochs könnte näher sein, als wir denken.