Wir schreiben das Jahr 2035. Sie überblicken eine Fabrikhalle, in der 300 humanoide Roboter wuseln, die schweigend und hocheffizient ihre Aufgaben erledigen. Es gibt nur ein Problem: Sie haben 300 dazugehörige Fernbedienungen, und Ihre Versuche, daraus einen gigantischen Mech-Anzug zu bauen, wurden von der HR-Abteilung bereits mehrfach unterbunden. Die schiere Logistik hinter der Verwaltung einer riesigen Roboter-Belegschaft ist eine der größten – wenn auch unglamourösesten – Hürden auf dem Weg in unsere automatisierte Zukunft. Was aber, wenn man einfach nur… denken müsste, und die Roboter würden gehorchen?

Das ist nicht die Eröffnungsszene eines Sci-Fi-Thrillers, sondern genau das Problem, das ein neues Open-Source-Projekt namens Kinexus lösen will. Während sich die Welt langsam auf invasive Gehirn-Computer-Schnittstellen (BCIs) wie Neuralink zubewegt, wählt Kinexus einen deutlich zugänglicheren Ansatz: Ein nicht-invasives EEG-Headset übersetzt die Gedanken und Sprachbefehle eines Nutzers direkt in Aktionen für eine ganze Flotte humanoider Roboter. Hier geht es weniger um chirurgische Implantate, sondern vielmehr um den Bau einer praktischen, skalierbaren Brücke zwischen dem menschlichen Geist und einer robotergesteuerten Belegschaft.

Die Skalierungskrise der Robotersteuerung

Da Fabriken und Logistikzentren zunehmend auf den Einsatz humanoider Roboter setzen, stehen sie vor einer gewaltigen operativen Herausforderung. Das Eins-zu-eins-Modell – ein Operator pro Roboter – lässt sich schlichtweg nicht skalieren. Aktuelle Steuerungsmethoden basieren oft auf komplexen Software-Interfaces oder klobigen „Teach Pendants“, die eine direkte, individuelle Programmierung erfordern. Das erzeugt einen Flaschenhals, der genau die Effizienz bremst, die Roboter eigentlich liefern sollen. Eine Handvoll Roboter zu managen ist komplex; hunderte zu koordinieren, ist ein logistischer Albtraum.

An diesem Punkt wird das Konzept eines zentralen, intuitiven Command-Centers entscheidend. Die Industrie braucht eine Art „Control Plane“ für ihre physischen Assets – eine Methode, mit der ein einzelner menschlicher Supervisor eine gesamte Flotte nahtlos orchestrieren kann. Kinexus schlägt vor, dass das intuitivste User-Interface jenes ist, mit dem wir alle geboren wurden: unser Gehirn.

Kinexus: Das Gehirn als neues Dashboard

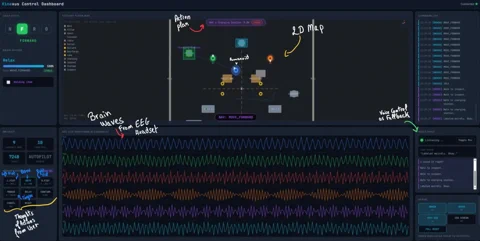

Im Kern ist Kinexus ein Kontroll-Dashboard, das als Echtzeit-Dolmetscher zwischen Ihnen und Ihrer Roboterarmee fungiert. Das vom KI-Entwickler Mourad Ouazmour konzipierte System, das primär in Python geschrieben wurde, soll als zentrales Nervensystem für die Fabrikautomatisierung dienen. Es visualisiert eingehende Hirnsignale von einem handelsüblichen EEG-Headset, übersetzt diese in diskrete Befehle und bildet die gesamte Fabrikumgebung ab, um die Situational Awareness zu gewährleisten.

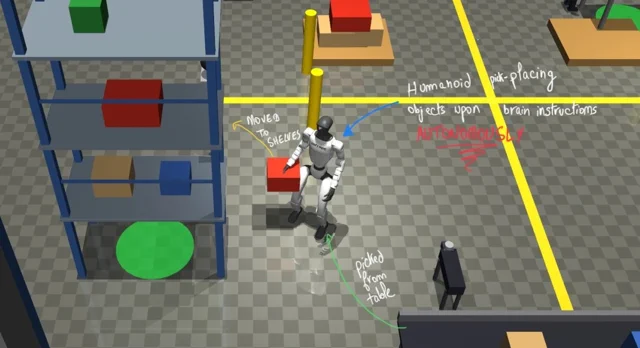

Das Steuerungsschema ist überraschend direkt. Wie der Entwickler erläutert, könnte ein Nutzer die rechte Faust ballen, damit ein Roboter nach rechts abbiegt, beide Fäuste ballen, um vorwärts zu gehen, oder sogar die Zunge schnalzen, um den Modus zu wechseln. Das Dashboard zeigt dies in Aktion:

- EEG-Live-Wellenform: Ein Echtzeit-Stream der elektrischen Aktivität Ihres Gehirns, aufgeteilt in verschiedene Kanäle.

- Methoden-Panel: Dies ist die Übersetzungs-Engine, in der spezifische mentale Cues (wie das Vorstellen einer geballten Faust) Roboteraktionen wie „MOVE_LEFT“ oder „MOVE_FORWARD“ zugeordnet werden.

- Fabrikplan: Ein 2D-Schema, das den Standort jedes Humanoiden, seinen Status und seinen aktuellen Aktionsplan anzeigt.

- Sprachsteuerung als Backup: Für komplexere, autonome Aufgaben umgeht das System die direkte Telepathie. Ein Nutzer kann einfach sagen: „Nimm den Karton vom Förderband und stelle ihn auf Palette 2“, und der zugewiesene Humanoide wird die gesamte Sequenz autonom navigieren und ausführen.

Sci-Fi-Ambitionen treffen auf Open-Source-Realität

Die Steuerung von Robotern mittels nicht-invasivem EEG ist zwar nicht völlig neu, aber die Anwendung in diesem Kontext – dem Flottenmanagement – macht Kinexus so spannend. Die Forschung im Bereich der EEG-basierten Steuerung konzentrierte sich bisher oft auf die Unterstützung von Menschen mit Behinderungen oder auf die Steuerung einzelner Roboter, wobei die Genauigkeitsraten für einfache Aufgaben je nach Methode zwischen 70 % und über 90 % liegen. Kinexus will diese Technologie aus dem Labor direkt in die Fabrikhalle bringen.

Die Entscheidung, Kinexus als Open-Source-Projekt auf GitHub zu veröffentlichen, ist sein wichtigstes Merkmal. Es demokratisiert den Zugang zu diesem fortschrittlichen Steuerungsparadigma. Es ist kein proprietäres Produkt eines Robotik-Giganten, sondern ein Toolkit, das jedem zum Experimentieren, Erweitern oder zur Integration mit Hardware wie der Open-Source-Plattform OpenBCI zur Verfügung steht. Dies lädt eine weltweite Community von Entwicklern ein, die inhärenten Herausforderungen der EEG-Steuerung anzugehen, wie etwa das Signalrauschen und die Notwendigkeit einer nutzerspezifischen Kalibrierung.

Natürlich ist der Weg von einem GitHub-Repository zu einer wuselnden, gedankengesteuerten Fabrik noch weit. Nicht-invasives EEG hat eine geringere Auflösung als invasive Methoden, und das Erreichen einer Zuverlässigkeit von über 99 %, wie sie für industrielle Anwendungen erforderlich ist, bleibt eine monumentale Aufgabe. Aber Kinexus verkauft kein fertiges Produkt; es präsentiert eine kraftvolle und kühne Vision. Es deutet auf eine Zukunft hin, in der menschliche Aufsicht in automatisierten Umgebungen weniger mit hektischem Tastendrücken zu tun hat, sondern vielmehr mit fokussierter, strategischer Intention. Vorerst bleibt es ein faszinierender Blick in eine Zukunft, in der das Management von hunderten Robotern nicht schwieriger sein könnte als ein flüchtiger Gedanke.